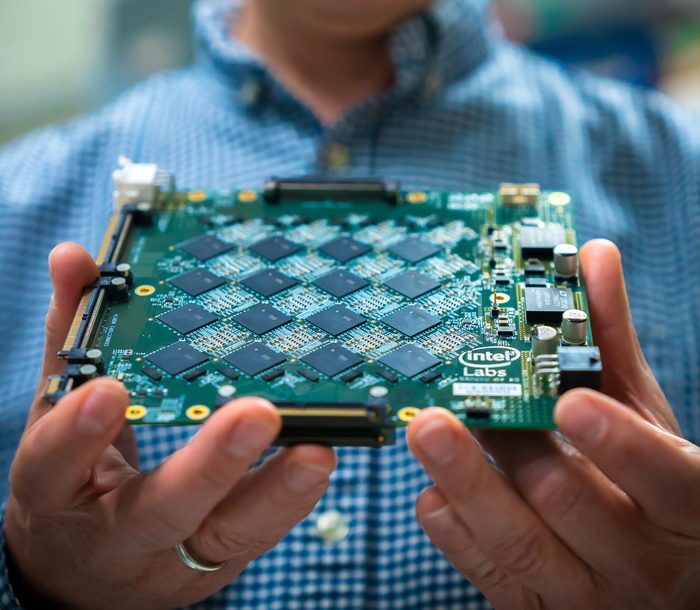

Due ricercatori della National University of Singapore (NUS), membri della Intel Neuromorphic Research Community (INRC), hanno presentato nuovi studi dimostrando di poter aumentare notevolmente l’efficienza dei robot dotandoli di senso del tatto. Una notevole innovazione, resa possibile dall’utilizzo di una pelle artificiale da loro recentemente sviluppata in combinazione con telecamere e sistemi di calcolo neuromorfico basati sui chip Loihi sviluppati da Intel, la cui struttura è ispirata a quella dei neuroni nel cervello umano.

Il risultato è un robot in grado di percepire stimoli tattili con una velocità più di 1.000 volte superiore rispetto al sistema nervoso umano, e di identificare la forma, consistenza e durezza di un oggetto 10 volte più rapidamente di un battito di ciglia. I vantaggi derivanti da tali abilità acquisite sono immediatamente evidenti: se ad esempio un braccio robotico dotato di pelle artificiale riesce a sentire ciò che manipola, allora può adattarsi con facilità ai diversi oggetti prodotti in fabbrica, utilizzando il tatto per identificare e afferrare oggetti non familiari con la giusta pressione. La capacità di sentire e percepire meglio l’ambiente circostante potrebbe poi consentire un’interazione più ravvicinata e sicura tra robot e persone, oppure potrebbe rappresentare un significativo passo in avanti per l’automati

“La ricerca della National University of Singapore ci offre un interessante sguardo nel futuro della robotica, dove le informazioni sono sia percepite sia elaborate sulla base degli eventi combinando molteplici modalità. Questo lavoro porta nuova evidenza di come il calcolo neuromorfico consenta di ottenere notevoli miglioramenti in termini di latenza e di consumi energetici, quando si riprogetta l’intero sistema secondo un paradigma basato sugli eventi che comprende sensori, formati dei dati, algoritmi e architettura dell’hardware», spiega Mike Davies, Direttore, Intel Neuromorphic Computing Lab.

Fondamentale per la riuscita delle sperimentazioni è stata l’adozione della tecnologia neuromorfica di Intel, che come detto si ispira al funzionamento dei neuroni del cervello per elaborare i dati provenienti dai sensori della pelle artificiale: “Realizzare un sensore ultrarapido per la pelle artificiale significa risolvere circa metà del problema di rendere più intelligenti i robot.”, spiega infatti il professor Harold Soh del Dipartimento di Informatica della NUS School of Computing. “Per completare il puzzle, serve anche un cervello artificiale in grado di percepire e imparare”.

Inizialmente i ricercatori hanno utilizzato una mano robotica dotata di pelle artificiale per leggere il Braille, passando i dati di percezione tattile a Loihi attraverso il cloud in modo da convertire i microrilievi percepiti dalla mano in un significato semantico. Loihi ha raggiunto un’accuratezza superiore al 92% nel classificare le lettere Braille, utilizzando al contempo 20 volte meno energia rispetto a un processore Von Neumann standard. Il passo successivo è stato quello di programmare un robot per classificare vari contenitori opachi contenenti diverse quantità di liquido, utilizzando input sensoriali dalla pelle artificiale e una telecamera basata su eventi. Utilizzando gli stessi sensori tattili e di visione, hanno anche testato la capacità del sistema di percepire e identificare lo slittamento rotazionale, importante per una presa stabile.

Una volta acquisiti questi dati sensoriali, il team li ha inviati a una Gpu e al chip di ricerca neuromorfica Loihi per confrontare le capacità di elaborazione. I risultati della ricerca dimostrano che la combinazione di visione e tatto basati su eventi utilizzando una rete neurale spiking ha consentito una precisione migliore del 10% nella classificazione degli oggetti rispetto a un sistema basato sulla sola visione.

“Siamo entusiasti di questi risultati. Mostrano che un sistema neuromorfico è un componente valido nella combinazione di molteplici sensori per migliorare la percezione dei robot.” – conclude il professor Soh – “È un passo verso la costruzione di robot robusti ed efficienti dal punto di vista energetico, in grado di rispondere rapidamente e appropriatamente a situazioni impreviste”.